Ollama如何在8845hs+32g+780m集显部署deepseek-r1 32b

Ollama 是一个轻量级的开源AI代理运行时,得益于AMD的开源态度,通过相关项目可以支持APU进行部署模型,降低能耗,实测8845hs+32G极限可以部署Deepseek-r1 32b(PS:速度略慢,推荐14b)。

按照以下步骤操作:

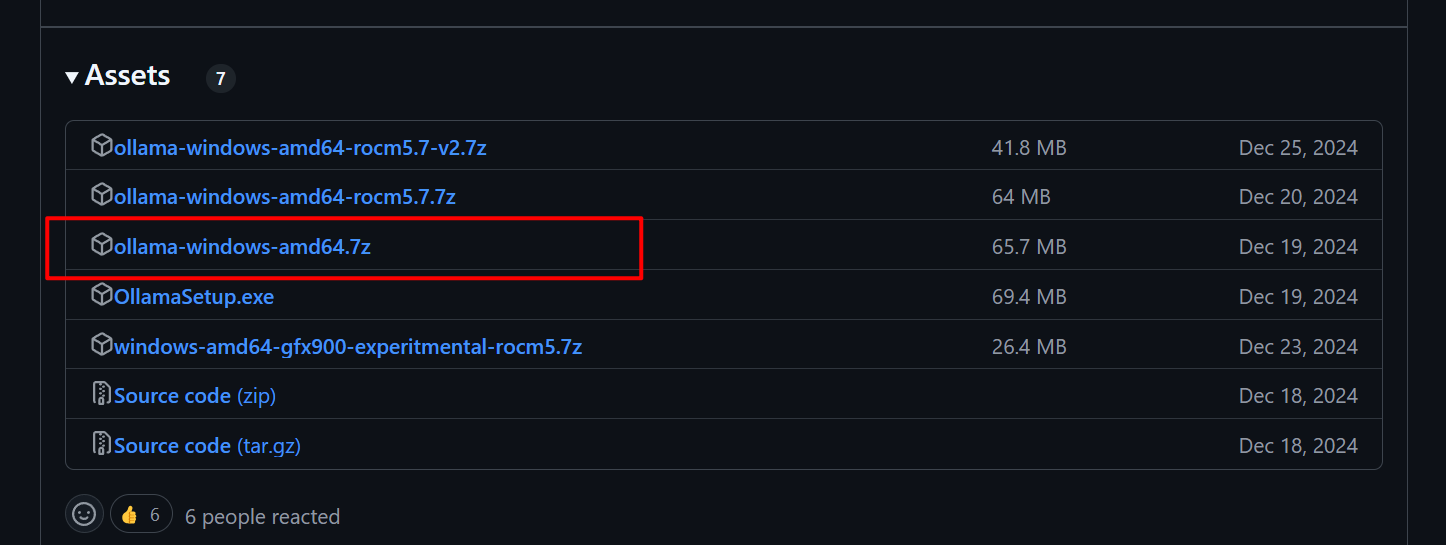

下载ollama for amd :

https://github.com/likelovewant/ollama-for-amd/releases

下载后解压

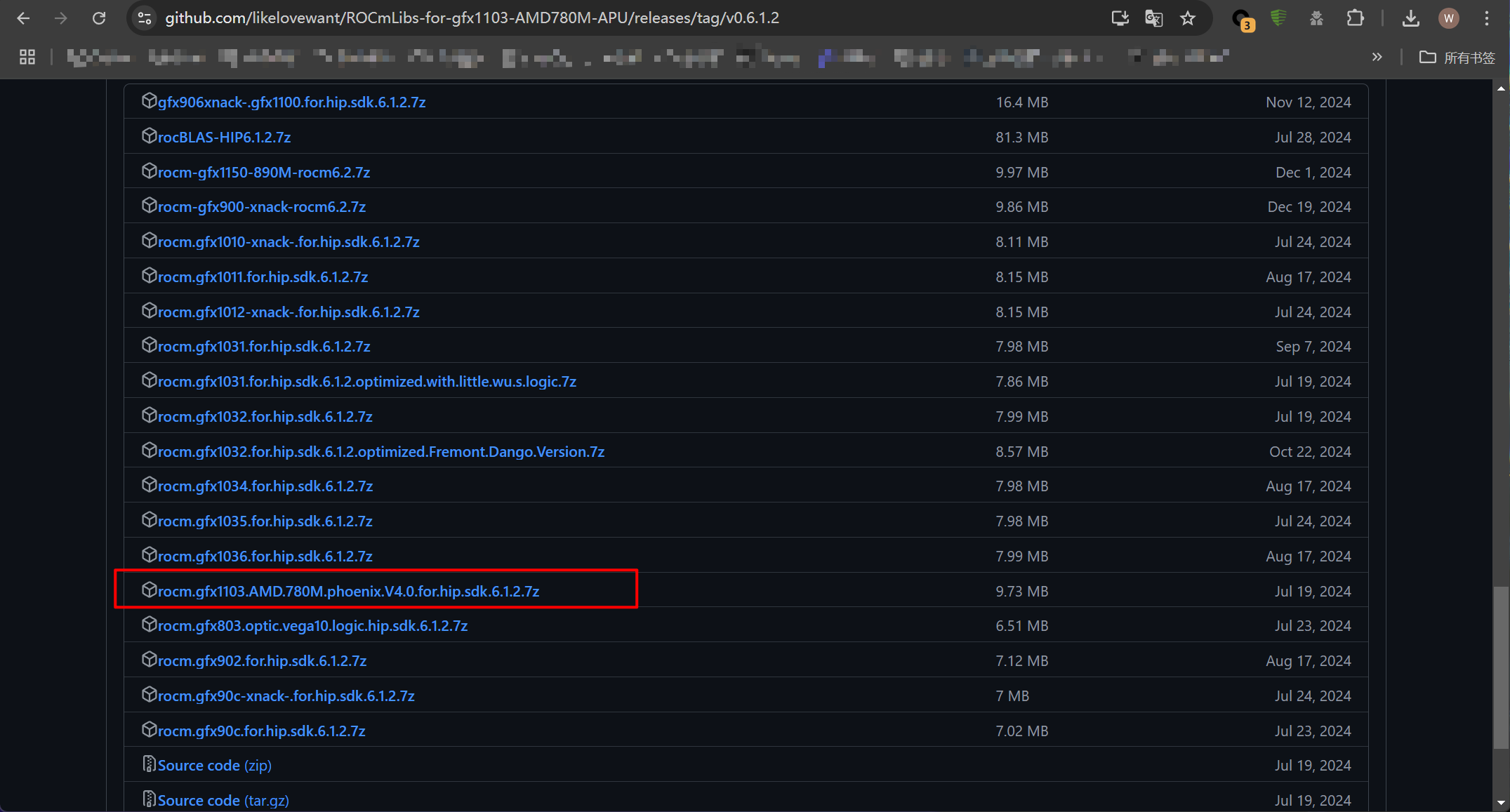

下载对应apu集显的ollama库(8845hs对应780m显卡):

https://github.com/likelovewant/ROCmLibs-for-gfx1103-AMD780M-APU/releases/tag/v0.6.1.2

下载后解压文件

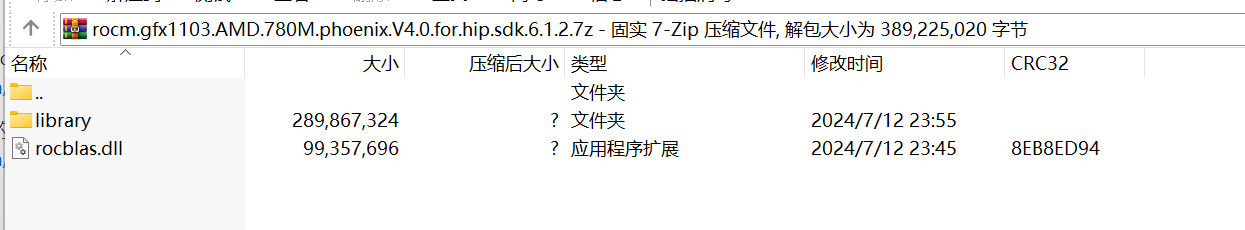

1.将rocblas.dll 覆盖到ollama-for-amd\lib\ollama文件夹对应文件

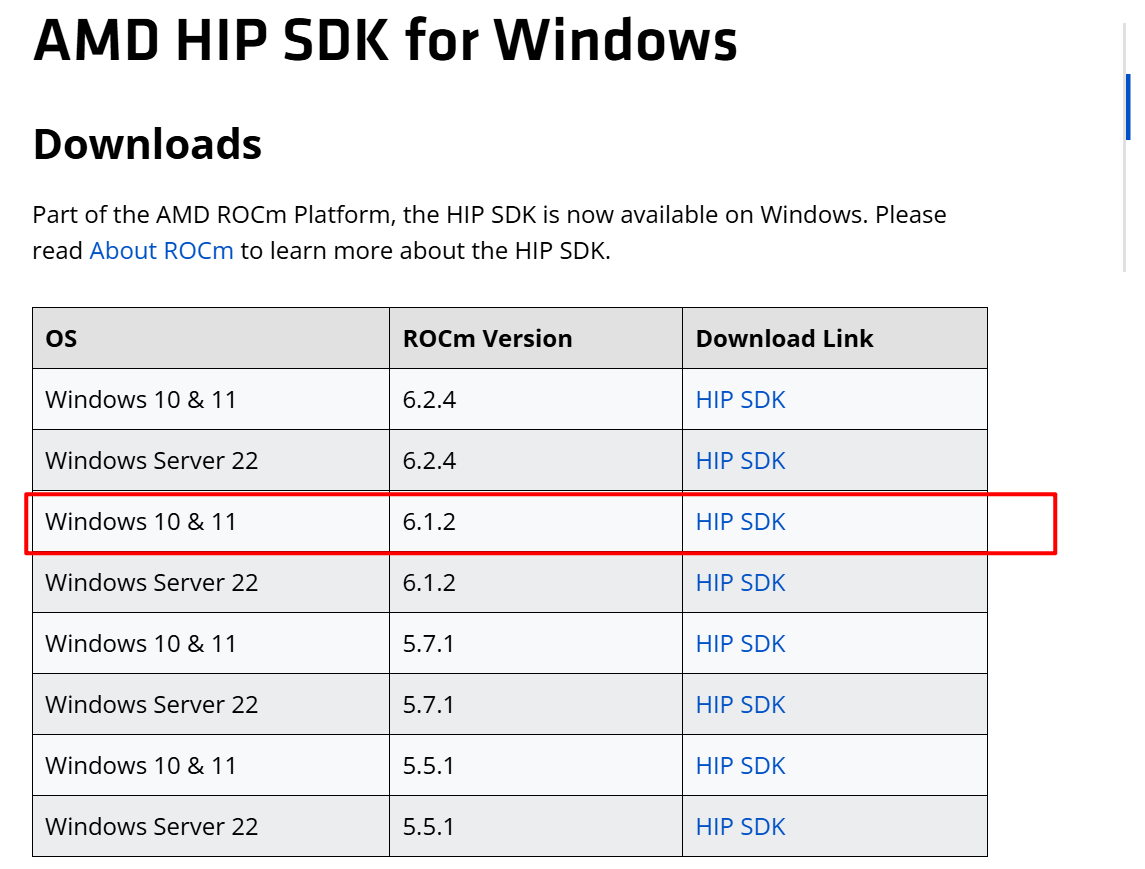

2.将library覆盖到ollama-windows-amd64\lib\ollama\rocblas文件夹下载对应AMD HIP SDK进行安装 (ROCmLibs-for-gfx1103-AMD780M-APU-v0.6.1.2驱动对应hip-6.1.2)

https://www.amd.com/zh-cn/developer/resources/rocm-hub/hip-sdk.html

我这里下载的是6.1.2(6.2.4本人测试部署32b模型会报错)

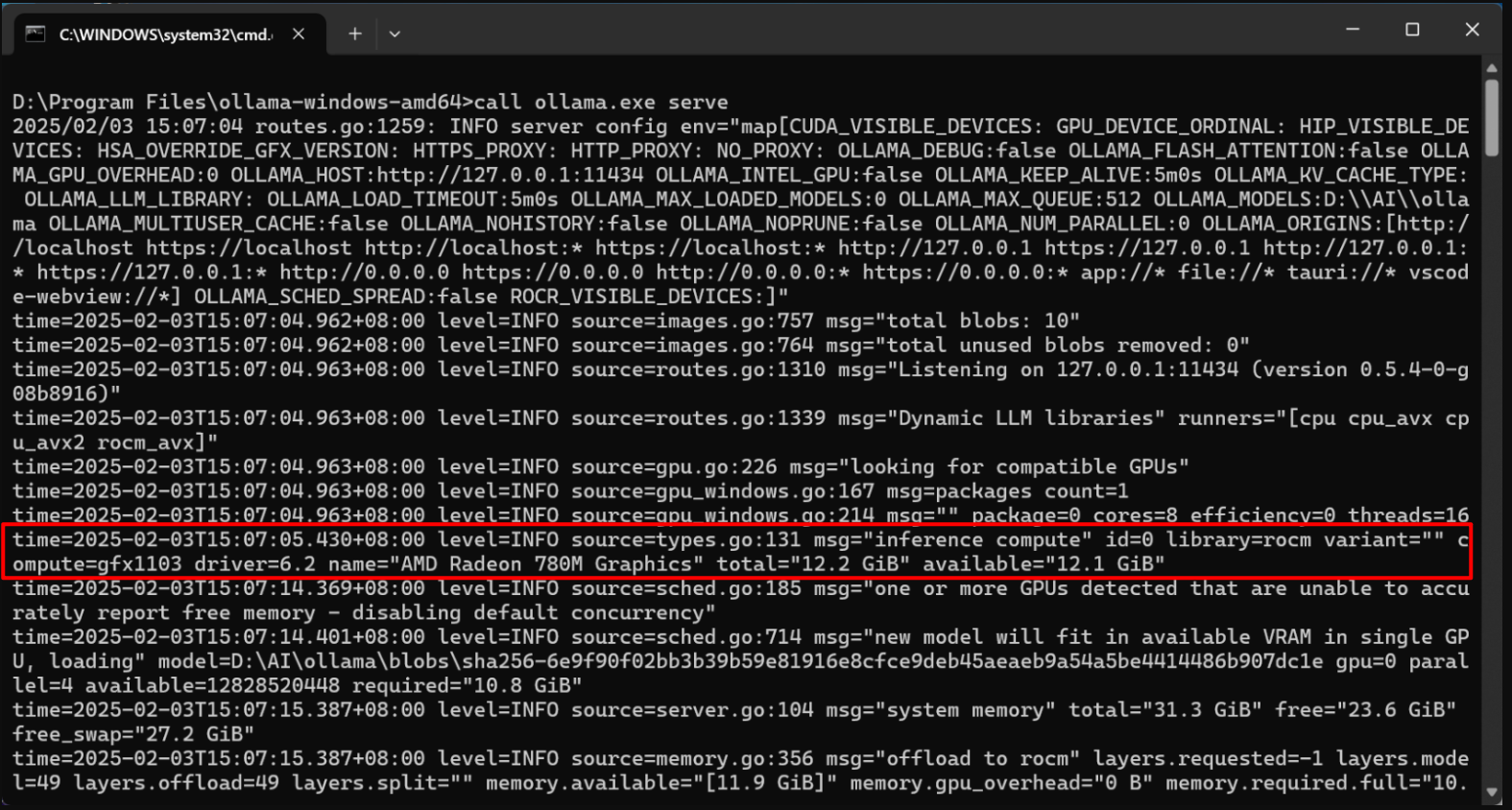

运行ollama服务,显示name=AMD Radeon 780M Graphices,即成功

其他操作跟ollama原版一样

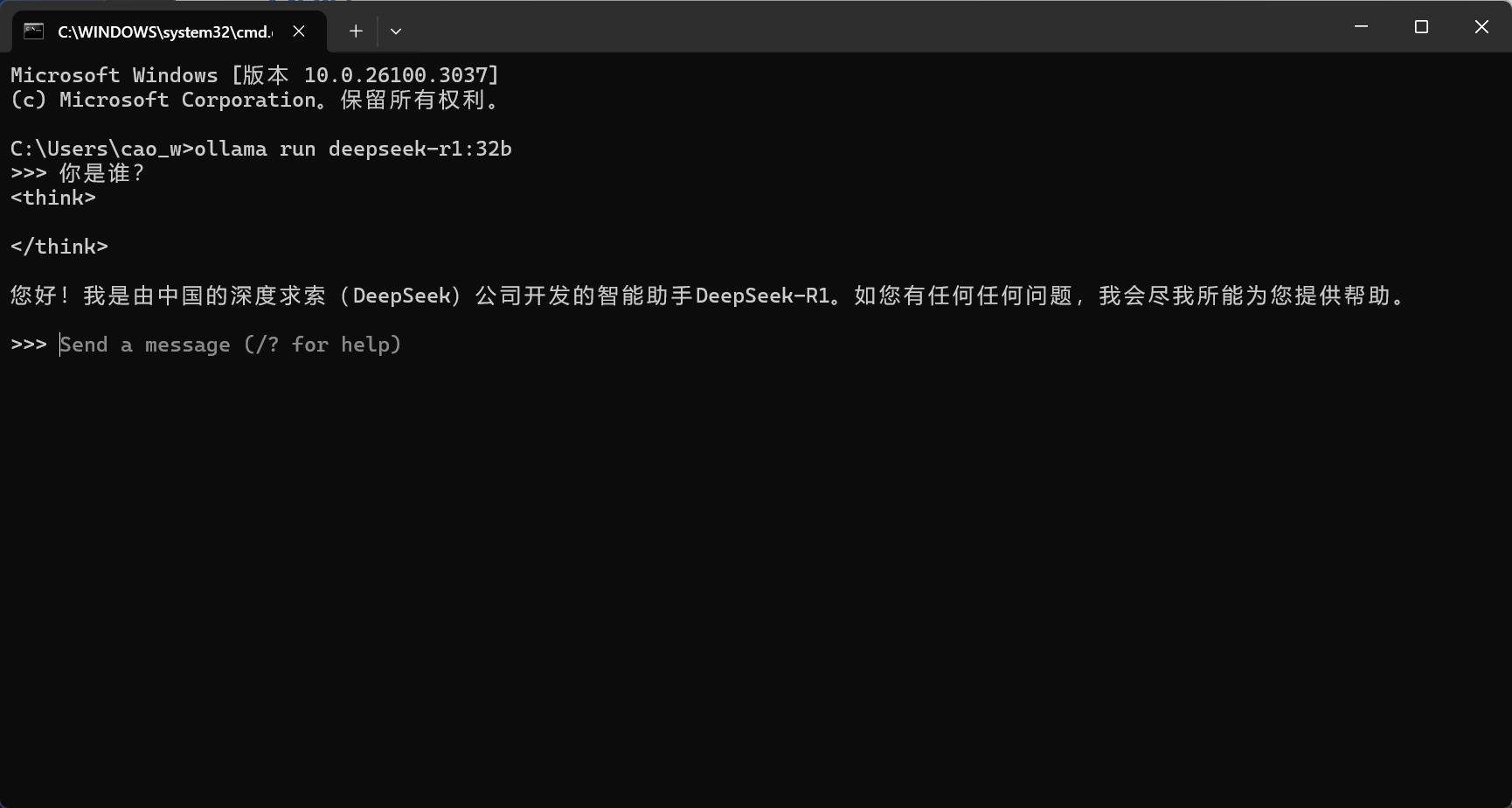

命令行工具->输入ollama run deepseek-r1:32b

通过以上步骤,可以在 Windows + 8845hs的集显中部署并使用 DeepSeek-R1 模型。

0